Схоже, китайці ніколи не відпочивають — стався офіційний реліз DeepSeek V3 😋

З цікавого:

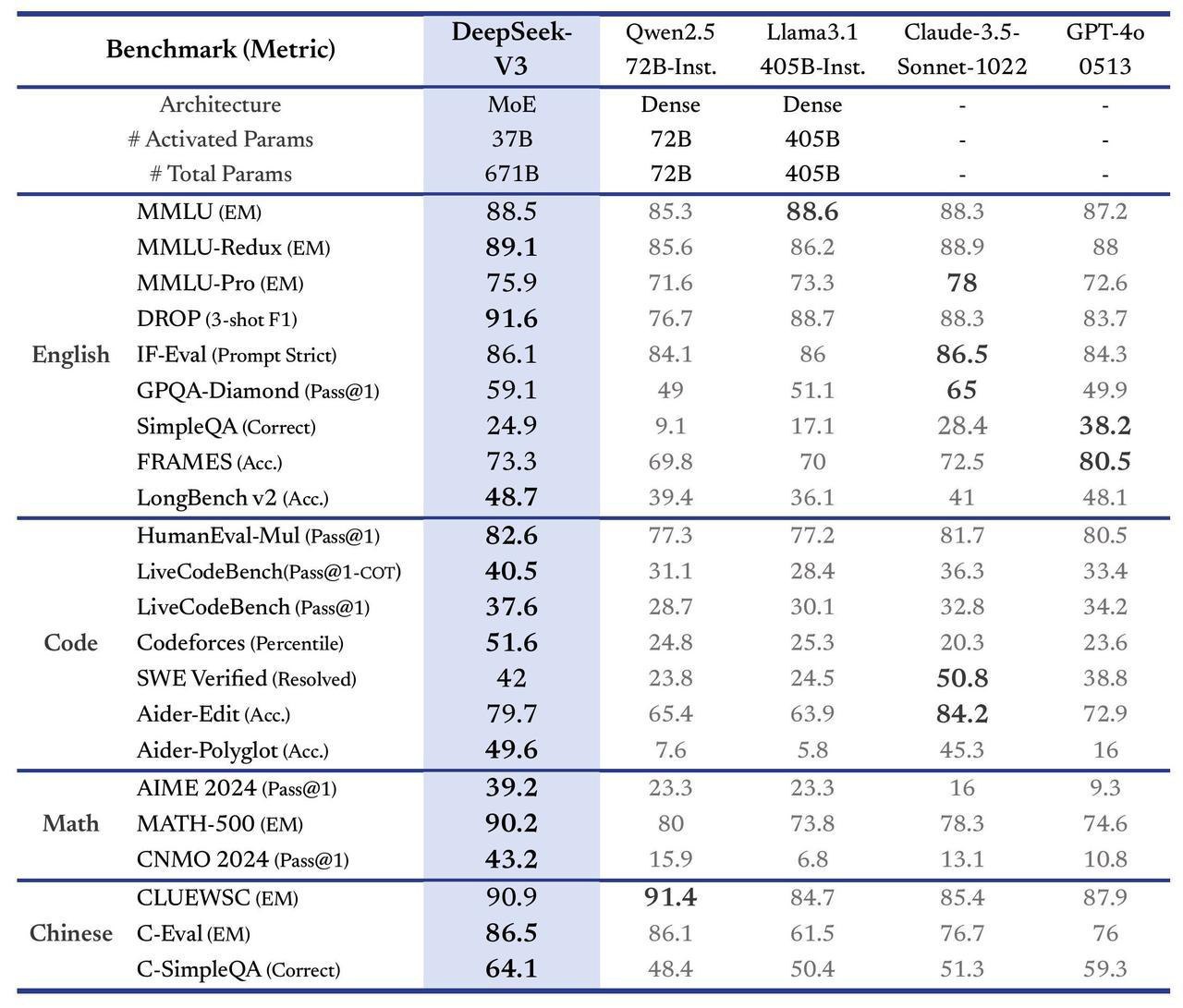

🪙 По бенчам рівень Claude Sonnet 3.6 та GPT-4o (щоправда, застарілої). В опен сорсі точно король;

🪙 Це офіційно найбільша модель в опен сорсі — а 671b параметрів. Але тут є хитрість — DeepSeek V3 використовує ту ж архітектуру, яку колись показав світу Mistral: модель «розбита» на декількох експертів, між якими розподілено параметри. Тому моделька хоч і найбільша, але активних параметрів лише 37b;

🪙 А ще китайці навчили модель генерувати по два токени за раз, щоб пришвидшити відповіді;

🪙 За основу взяли модель R1 (конкурент o1) від цієї ж команди, тому іноді можна побачити, як модель довго розмірковує в чаті (як на відео);

🪙 Вже можна юзати безплатно у чаті.

ооо нейромережеве

З цікавого:

🪙 По бенчам рівень Claude Sonnet 3.6 та GPT-4o (щоправда, застарілої). В опен сорсі точно король;

🪙 Це офіційно найбільша модель в опен сорсі — а 671b параметрів. Але тут є хитрість — DeepSeek V3 використовує ту ж архітектуру, яку колись показав світу Mistral: модель «розбита» на декількох експертів, між якими розподілено параметри. Тому моделька хоч і найбільша, але активних параметрів лише 37b;

🪙 А ще китайці навчили модель генерувати по два токени за раз, щоб пришвидшити відповіді;

🪙 За основу взяли модель R1 (конкурент o1) від цієї ж команди, тому іноді можна побачити, як модель довго розмірковує в чаті (як на відео);

🪙 Вже можна юзати безплатно у чаті.

ооо нейромережеве